В медиапространстве о «новой этике» – концепции, описывающей нормы и практики, направленные на преодоление дискриминации и неравенства в 21-ом веке – дискуссируют уже не первый год. Стремление общества к инклюзивности повышает запрос на освещение тем, cвязанных с уязвимыми группами: ЛГБТК + сообществом, людьми с инвалидностью, мигрантами, людьми из секс-бизнеса, наркопотребителями и людьми с ВИЧ. Однако зачастую мы неосознанно подкрепляем существующие предрассудки, используя привычные нам, но неуважительные для тех, к кому они относятся, слова. Вместе с журналистом, экспертом по языку вражды и сооснователем организации «Журналисты за толерантность» Олегом Рожковым рассказываем о том, как с помощью веб-сервиса J4T-checker избежать некорректных выражений и сделать свой вклад в развитие толерантности и эмпатии к окружающим.

Почему инклюзивный язык больше, чем тренд?

В 2019 году 30 независимых экспертов ООН обратились с открытым письмом к государствам и владельцам социальных сетей, призывая их сделать всё возможное для того, чтобы остановить распространение языка вражды. Высказывания, оскорбляющие уязвимые группы либо делающие их невидимыми, приводят к напряжению и развитию конфликтов в обществе. Именно поэтому политкорректность – не прихоть создателей сериалов и фильмов на Netflix, а необходимая практика для мирного сосуществования и взаимодействия с окружающими.

– Очень важно понимать, что группы отличаются, имеют свои особенности и специфику, но в то же время признавать их равенство и равность. К этому нас, в том числе, отсылают статьи о равенстве Всеобщей декларация прав человека. Именно поэтому инклюзивное отношение к разным группам людей является большой ценностью, – комментирует эксперт.

Что такое J4T-checker, и как он упрощает работу журналиста?

На тему инклюзивного языка написано множество книг, пособий, брошюр и статей. Однако журналистом, которые ежедневно пишут тексты на различные темы, зачастую не хватает времени на то, чтобы ознакомиться с этими материалами и удостовериться в корректности используемых выражений.

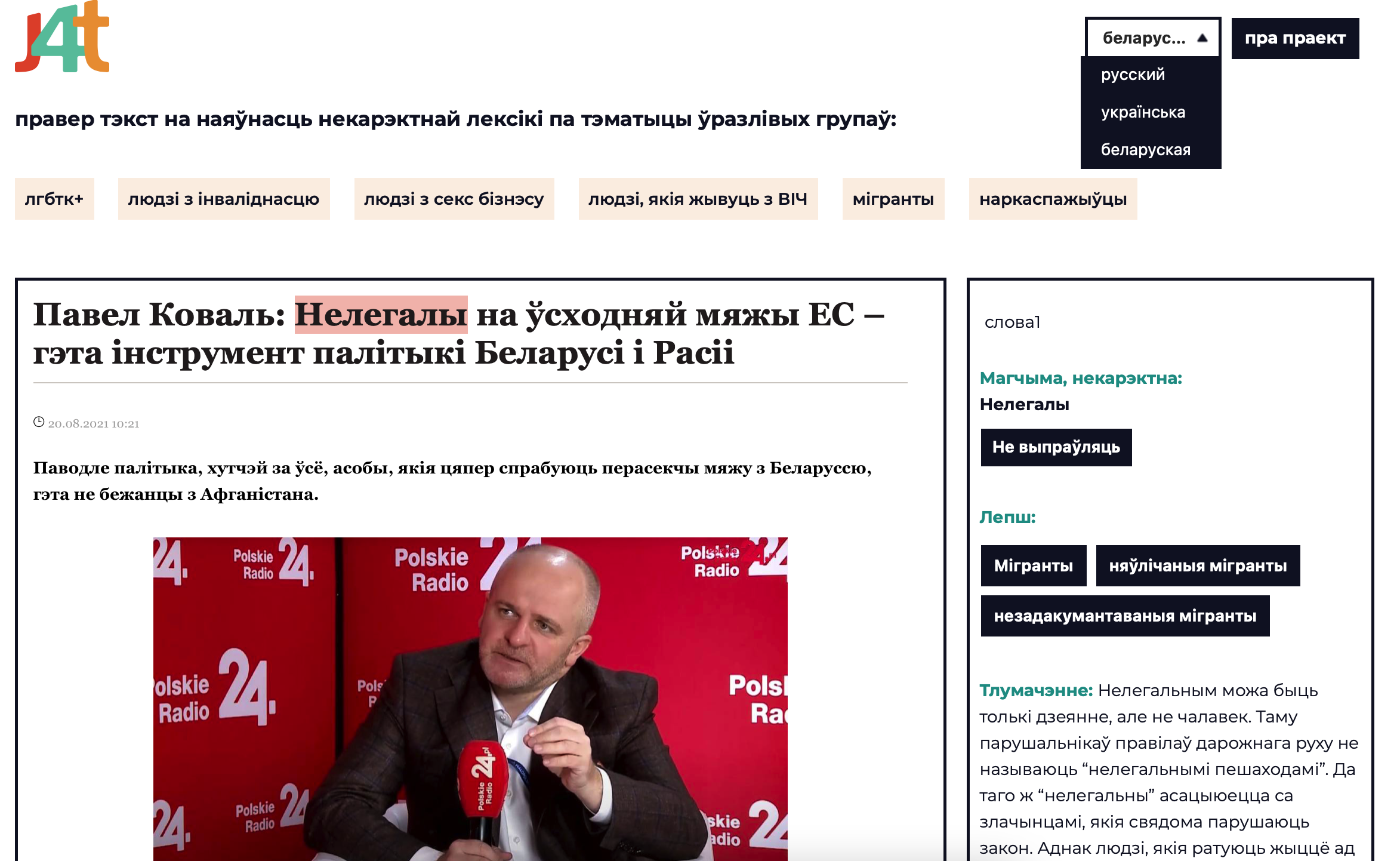

– Мы подумали, что было бы здорово собрать рекомендации от разных экспертов и автоматизировать их так, чтобы не нужно было искать какое-то конкретное слово, вызывающее сомнения, а проверить текст целиком одним кликом. Так и появился J4T-checker – сервис для выявления маркеров языка вражды, – рассказывает Олег.

Проект поддержали международная правозащитная организация Article 19, а также независимые общественные инициативы Prague civil Society Centre и Free Belarus Center. В качестве экспертов выступили представители организаций Human Constanta, «Офис по правам людей с инвалидностью», «Белсеть антиСПИД», MAKEOUT, «100% життя», «Гендер Зед», «Доступно.UA», «Без кордонів» и «Альянс общественного здоровья».

В настоящий момент j4t-checker доступен на трёх языках: беларусском, русском и украинском. Каждая версия учитывает культурные коннотации языка.

– Есть такое правило: каждая группа имеет право на самоопределение, поэтому многие формулировки объясняются местным контекстом и тем, как представители групп или активисты транслирует, какие термины использовать, а какие – нет. Например, если люди с инвалидностью просят не называть их «людьми с ограниченными возможностями», потому что, благодаря наличию безбарьерной среды

или ассистивным технологиям, они не считают свои возможности ограниченными, мы должны прислушиваться к их мнению. Это «золотое правило» мы и учитывали при создании сервиса, – поясняет Олег.

Как использовать веб-сервис?

j4t-checker не требует регистрации или установки каких-либо сторонних программ на компьютер. Чтобы проверить текст, нужно выбрать язык, скопировать и вставить содержимое в специальное поле на странице и нажать «Проверить». Система определит некорректную лексику и выделит её красным цветом. Кликнув на выражение, пользователь получит не только рекомендации по замене, но и краткое объяснение, почему подобной формулировки следует избегать.

Как j4t—checker работает?

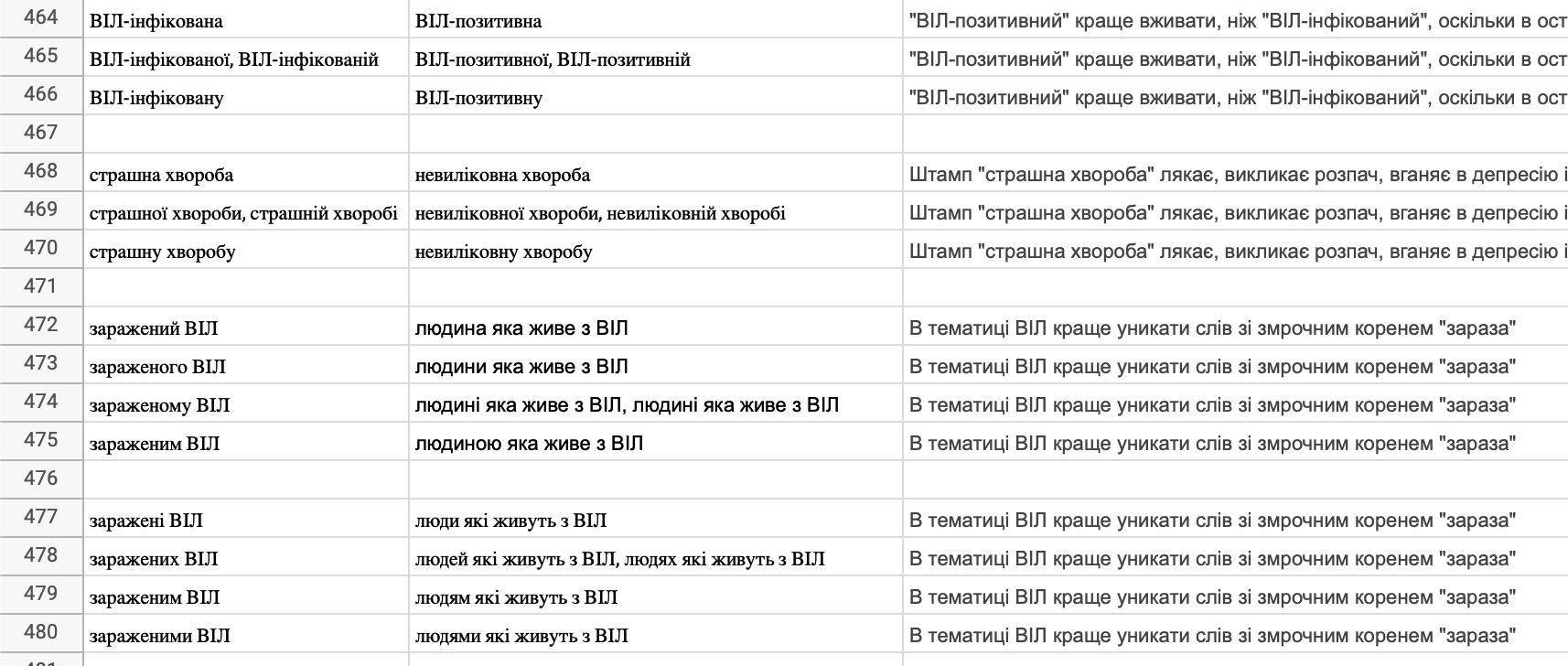

Введённый пользователем текст проверяется алгоритмом, который определяет стигматизирующую лексику и предлагает инклюзивную альтернативу на основе базы данных, разработанной при поддержке специалистов и активистов правозащитных организаций. В настоящий момент база данных j4t содержит больше 2000 пар-замен, наиболее часто используемых для описания представителей ЛГБТК + сообщества, людей с инвалидностью, мигрантов, людей из секс-бизнеса, наркопотребителей и людьей с ВИЧ. При этом веб-сервис не сохраняет пользовательский контент, а лишь считывает количество проанализированных текстов и найденных некорректных слов для статистики.

Как веб-сервис будет развиваться?

В ближайшем будущем команда «Журналисты за толерантность» планирует запустить плагин для браузеров, который позволит проверять на некорректную лексику тексты, размещённые на веб-страницах, тем самым устраняя надобность в копировании и вставке контента в специальное поле. По словам Олега, в дальнейшей перспективе планируется обучение нейронных сетей распознаванию менее явных проявлений языка вражды: например, использование литературных, на первый взгляд нейтральных слов с целью дискриминации уязвимых групп.

Заменяя слова в цитатах на корректные, мы ограничиваем свободу слова?

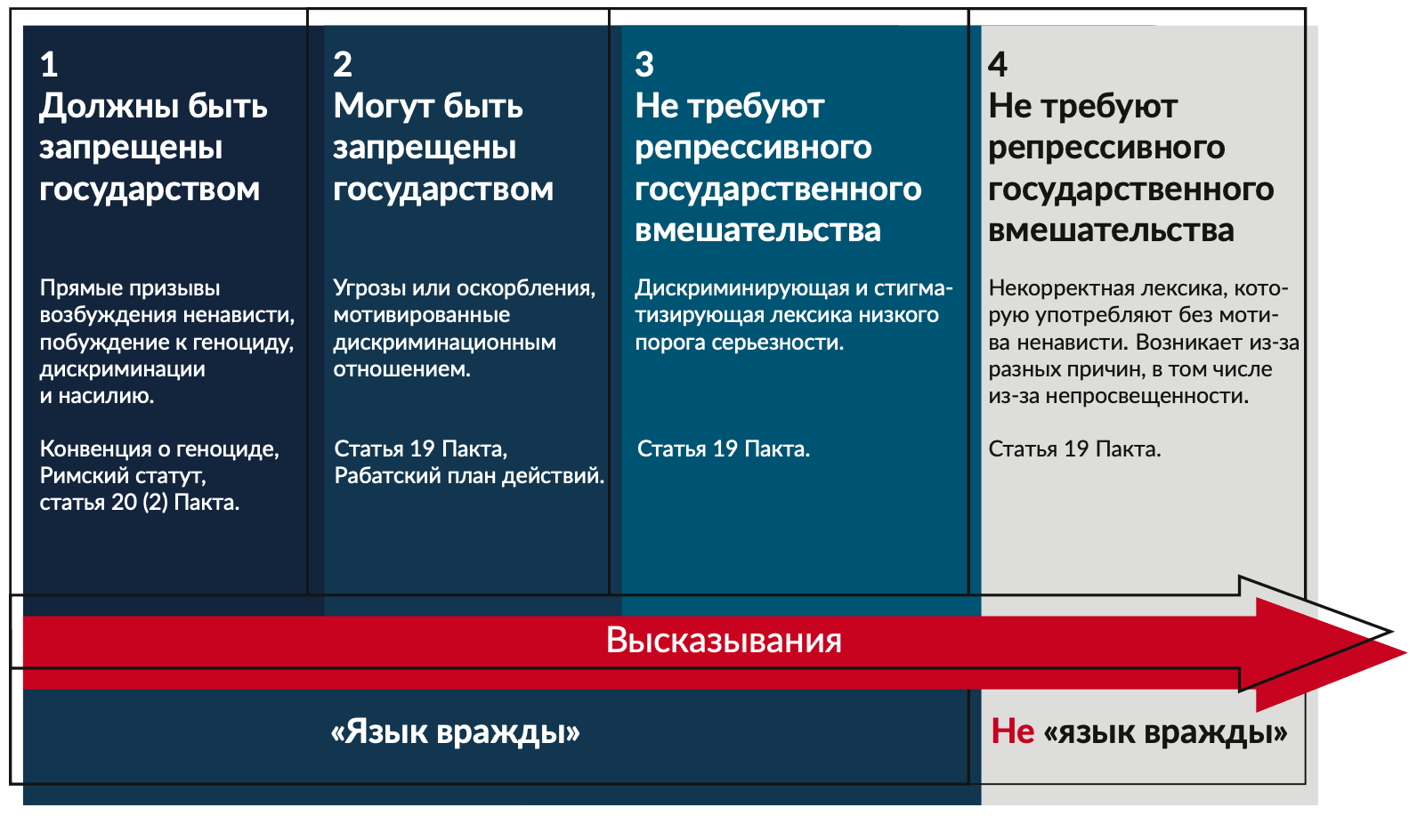

Однозначного ответа на данный вопрос нет. Так, например, герой материала может использовать слово, имеющее негативную коннотацию, случайно, а может выражать через него свою позицию. Олег советует прежде всего задаться вопросом, нарушает ли высказывание законодательство или просто является неэтичным.

– Если мы понимаем, что для общественного дискурса важно дать комментарий, поскольку высказывание обличает проблему и не несёт в себе рисков возникновения преступления на почве ненависти, то мы можем использовать такую цитату. Однако в этом случае мы должны сбалансировать данный материал высказыванием представителя правозащитной организации либо человека из комьюнити. Вы всегда должны думать о том, нужно ли давать площадку для разжигания ненависти на страницах вашего медиа, социальных сетях и так далее. Это главный вопрос, на который должен ответить журналист, когда он видит в цитате героя слова-маркеры либо ретранслирует высказывание, содержащее призывы к ненависти и насилию, – считает эксперт.